这款名为SHARP的模型,可在一秒内从单张图片重建逼真3D场景。以下为示例展示。

SHARP模型表现卓越

苹果发表了研究《一秒内的单目视图合成》,详述了如何训练模型从单张2D图像重建3D场景,并确保距离与比例符合真实世界。

苹果研究人员如此介绍该研究:

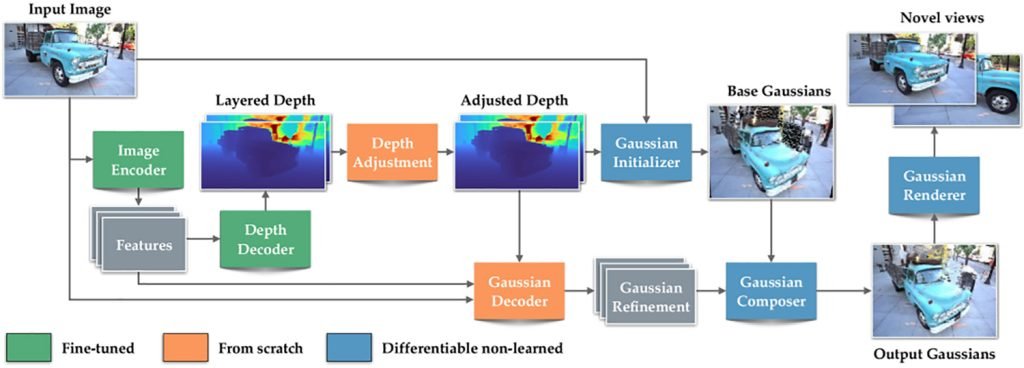

我们提出SHARP,一种从单张图像合成逼真视图的方法。给定一张照片,SHARP能回归出场景的3D高斯表示参数,通过神经网络单次前向传播,在标准GPU上不到一秒即可完成。生成的3D高斯表示可实时渲染,为邻近视角提供高分辨率逼真图像。该表示具备度量特性,支持绝对比例和度量相机运动。实验显示,SHARP在跨数据集上实现强大零样本泛化能力。在多个数据集上刷新纪录,较之前最佳模型,LPIPS降低25-34%,DISTS降低21-43%,合成时间缩短三个数量级。

简言之,模型预测场景的3D表示,支持从邻近视角渲染。

3D高斯本质是空间中的微小模糊色光团。数百万个此类团块组合,便能从特定视角精准重建3D场景。

传统高斯泼溅方法需多视角拍摄同一场景的数十至数百张图片。而苹果SHARP模型仅凭单张照片,经神经网络单次前向传播即可预测完整3D高斯场景表示。

为实现此目标,苹果用海量合成与真实数据训练SHARP,使其学习跨场景的深度与几何共性模式。

因此,面对新照片时,模型先估计深度,再基于所学优化,最后单次预测数百万3D高斯的位姿与外观。

这使得SHARP无需多图或耗时的逐场景优化,即可重建合理3D场景。

但需权衡取舍。SHARP精准渲染邻近视角,而非合成场景未可见部分。这意味着用户不可过度偏离原拍摄视点,因模型不生成完全不可见区域。

苹果借此确保模型快至一秒内生成结果,且稳定输出更可信。下图对比SHARP与先前强劲方法Gen3C:

与其听信苹果之言,不如亲自尝试。为此,苹果已将SHARP开源至GitHub,用户正分享各自测试结果。

近期X平台用户分享示例如下:

您或许注意到末条帖子实为视频。这已超出苹果对SHARP的初衷,但展现了该模型或其底层技术在未来工作中的拓展潜力。