在最新研究中,苹果成功训练AI模型识别出它训练数据中完全没有出现过的手势!以下是完整细节。

什么是EMG?

苹果在其机器学习研究博客上发表了一项全新研究,论文名为《EMBridge: 通过跨模态表示学习提升EMG信号的手势泛化能力》。该研究将于2026年4月在ICLR 2026大会上正式亮相。

研究中,科学家们展示如何让AI模型学会识别训练集中从未出现过的特定手势。

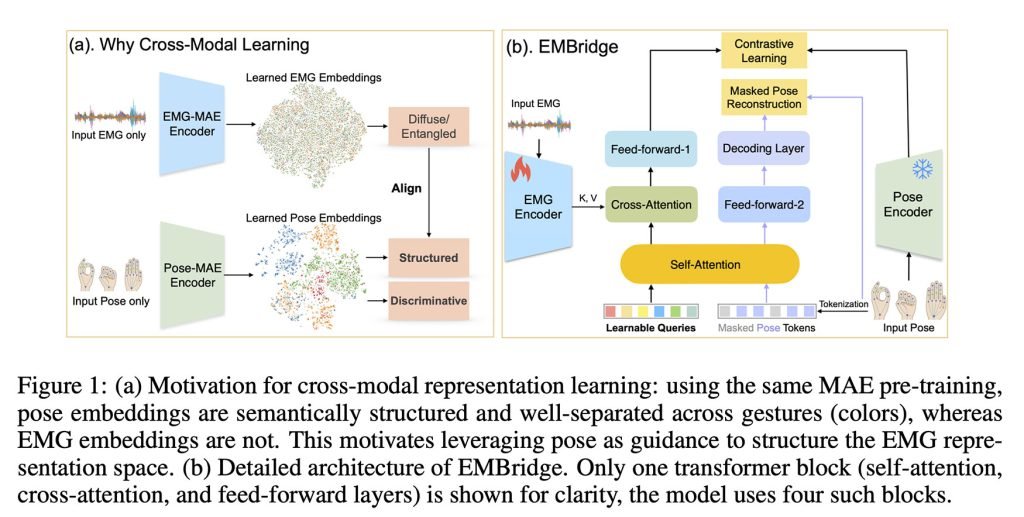

他们开发了EMBridge——“一种跨模态表示学习框架,用于弥合EMG信号与手部姿态之间的模态鸿沟”。

EMG(肌电图,Electromyography)通过测量肌肉收缩时产生的电活动,已广泛应用于医学诊断、物理治疗以及假肢控制等领域。

近年来(虽然并非全新领域),EMG技术在可穿戴设备和AR/VR系统中得到越来越广泛的探索。

例如Meta的Ray-Ban智能眼镜就采用了名为Neural Band的腕带设备,据官方描述,它“通过解读你的肌肉信号来操控Meta Ray-Ban Display的各项功能”。

而在苹果的这项研究中,用于训练的EMG信号并非来自腕带设备。研究团队使用了两个数据集:

- emg2pose:“……一个大规模开源EMG数据集,包含193名受试者共370小时的表面肌电(sEMG)数据以及同步手部姿态数据,涵盖29种不同行为组,包括多种离散和连续手部动作(如握拳、数到五等)。手部姿态标签由高精度动作捕捉系统生成。完整数据集包含超过8000万条姿态标签,规模堪比最大的计算机视觉数据集。每位受试者在每个手势类别下完成四次不同EMG腕带位置的录制,每次录制时长45–120秒,其间反复执行3–5个相似手势或自由动作。我们采用不重叠的2秒窗口作为输入序列。EMG信号经过实例归一化、带通滤波(2–250 Hz)和60 Hz陷波滤波处理。”

- NinaPro DB2:“我们使用两个NinaPro EMG数据集对EMBridge进行更全面评估。其中NinaPro DB2用于预训练,包含40名受试者的配对EMG-姿态数据。该数据集记录了40名健康受试者执行的49种手势(包括基础手指屈伸、功能性抓握和组合动作)。EMG信号由前臂12个电极以2kHz采样率采集,同时使用数据手套记录手部运动学数据。在下游手势分类任务中,我们使用NinaPro DB7,该数据集包含20名非截肢受试者,使用与DB2相同的EMG设备和手势集采集。”

基于以上内容,不难想象苹果的EMBridge技术未来很可能应用于下一代Apple Watch或其他可穿戴设备,用来控制Apple Vision Pro、Mac、iPhone,甚至传闻中的苹果智能眼镜等产品。

从全新交互方式到无障碍辅助功能的提升,其潜在影响非常巨大。

当然,论文本身并未提及任何具体即将推出的苹果产品或应用,但明确指出:

我们框架的一个潜在实际应用是可穿戴人机交互。在VR/AR以及假肢控制等场景中,腕部穿戴设备需要持续从EMG信号推断手势,以驱动虚拟化身或机械手。

EMBridge到底是什么?

EMBridge是研究团队用来连接真实肌电肌肉信号与结构化手部姿态数据之间的桥梁。

该模型采用跨模态框架,首先分别对EMG和手部姿态数据进行独立预训练。

随后通过表示对齐,让EMG编码器能够从姿态编码器中学习,从而使EMBridge学会从EMG信号中识别手势模式。

在此基础上,研究团队进一步使用掩码姿态重建任务进行训练:隐藏部分姿态数据,让模型仅依靠从EMG信号提取的信息来重建这些隐藏部分。

研究人员总结成果如下:

“据我们所知,EMBridge是首个实现可穿戴EMG信号零样本手势分类的跨模态表示学习框架,展现了在真实可穿戴设备上进行手势识别的巨大潜力。”

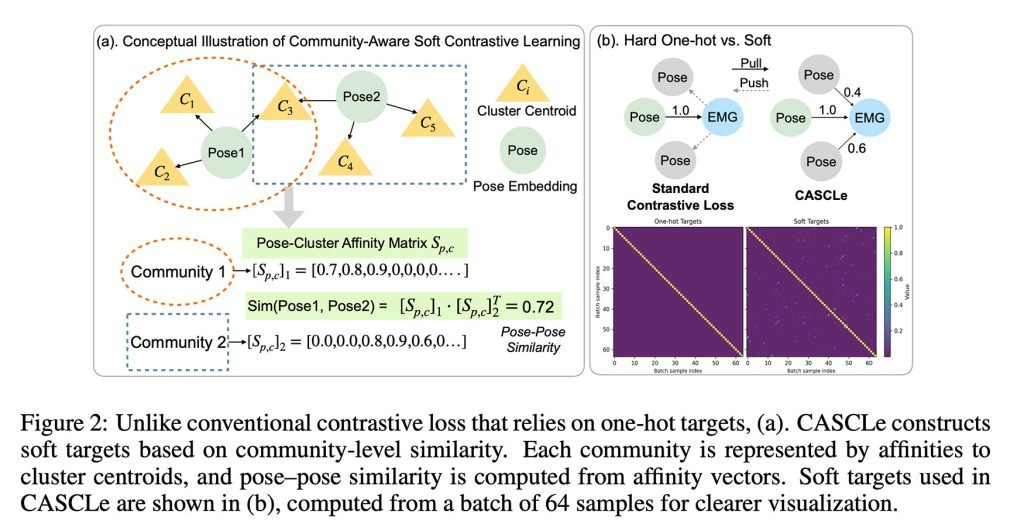

为减少因相似手势被当作负样本而导致的训练误差,团队还让模型学会识别哪些姿态代表相似的手部构型,从而对这类姿态生成软目标,而不是完全视作无关。

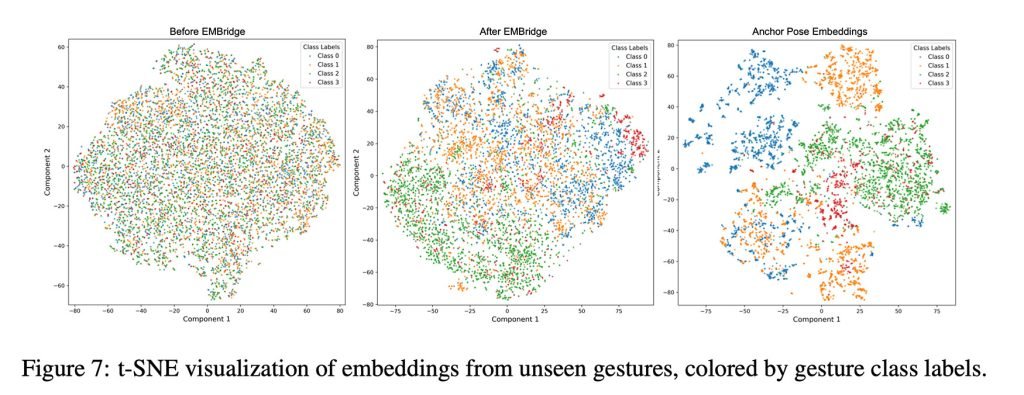

这一改进显著优化了模型的表示空间,大幅提升了对从未见过手势的泛化能力。

作者在emg2pose和NinaPro两个基准测试上对EMBridge进行了评估,结果显示其在各项指标上持续超越现有方法,尤其在零样本(从未见过)手势识别任务上表现突出。更重要的是,它仅使用了40%的训练数据就取得了更好效果。

论文也指出了一个重要局限:模型依赖同时包含EMG信号和同步手部姿态数据的专用数据集,这类数据集采集难度较大。

尽管如此,在EMG设备控制技术日益兴起的当下,这项研究依然极具价值和前瞻性。

想了解EMBridge的完整技术细节(包括Q-Former、MPRL、CASCLe等组件),请点击此处查看原文。