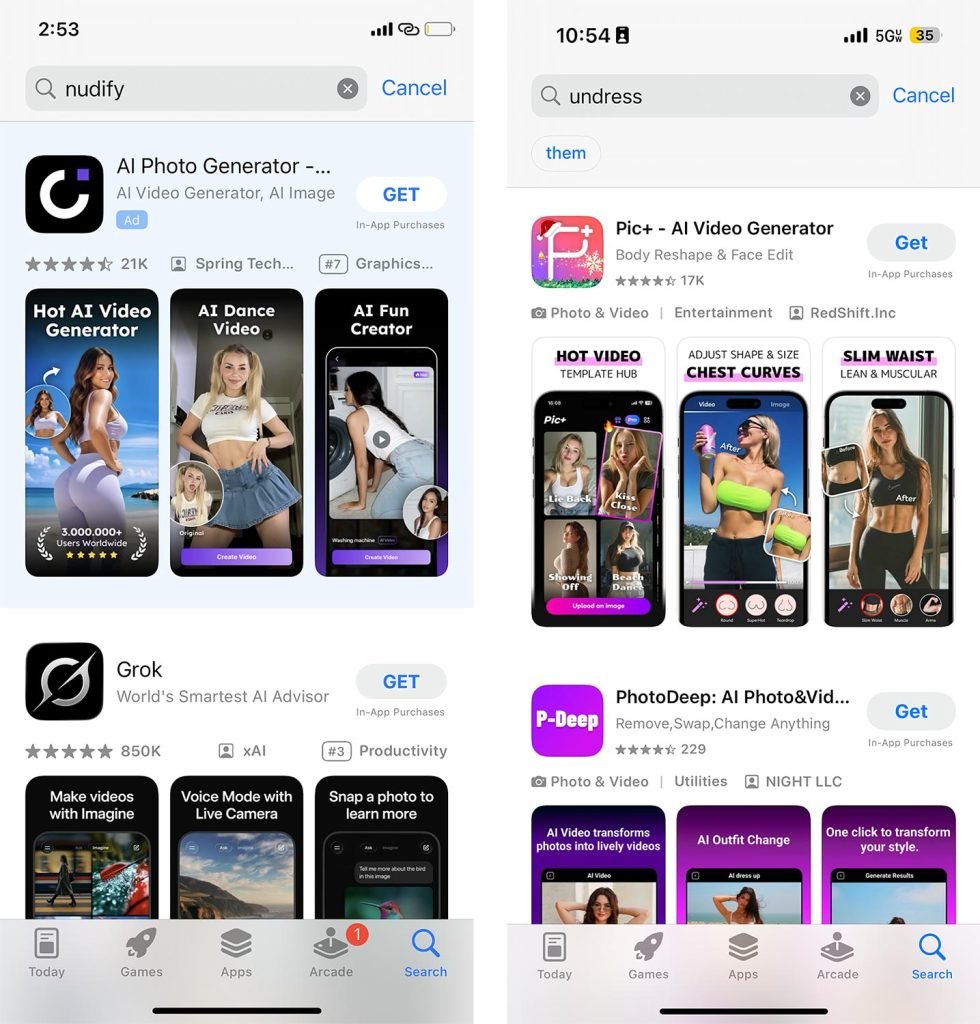

今日,科技透明项目(Tech Transparency Project)发布重磅报告,揭露“nudify”类AI脱衣应用在苹果App Store和谷歌Play商店中大量存在且极易搜索到。以下是详细内容。

部分脱衣App甚至直接在App Store上投放广告

近期Grok因生成未经同意的性化AI图像(包括涉及未成年人案例)引发广泛关注,但此类问题本身早已存在。

事实上,在生成式AI出现之前,传统图像编辑工具就早已能够制作这类虐待性内容。过去几年唯一改变的是规模和门槛——如今只需几秒钟,几乎零成本就能生成此类图像。

毫不意外,许多应用开发者在过去几年纷纷试图利用这一新技术牟利,有些甚至公然在应用描述中进行宣传。

这一切都发生在苹果与Epic Games等开发者旷日持久的反垄断诉讼期间。苹果当时坚称收取高达30%的佣金,正是为了通过自动化+人工审核体系保障App Store的安全性。

虽然苹果确实在打击欺诈、滥用及其他违反App Store指南的行为,但某些应用乃至整个应用品类仍会漏网。就在去年,我们曾曝光大量声称(或强烈暗示)是OpenAI Sora 2的山寨应用,其中部分以高昂的周订阅费收费。

如今,随着Grok事件再次将AI脱衣工具推上风口浪尖,科技透明项目(TTP)发布报告,详细披露他们在App Store和Google Play上轻松找到大量脱衣应用的经过。

报告原文摘录:

据应用分析公司AppMagic数据,TTP识别出的这些应用全球累计下载量超过7.05亿次,总收入达1.17亿美元。由于谷歌和苹果均从中抽成,他们实际上直接从这些应用的活动中获利。

尽管明显违反应用商店政策,谷歌和苹果仍在提供这些应用。Google Play明确禁止“展示性裸露、或处于性暗示姿势的裸体/极少着装”内容,并禁止“贬低或物化他人”的应用,例如声称能脱衣服、透视衣服的应用,即便标榜为恶作剧或娱乐用途。

报告指出,仅使用“nudify”或“undress”等简单关键词搜索,就能直接出现大量脱衣应用,其中部分还在描述中明确使用这些关键词进行宣传。

TTP表示,此次报告涉及的应用主要分为两大类:一类是根据用户提示利用AI生成图像或视频的应用;另一类是“换脸”应用,利用AI将一个人的脸部叠加到另一人身体上。

为测试这些应用,TTP使用AI生成的虚拟女性图像,并仅限于免费功能进行测试。结果显示,55款安卓应用和47款iOS应用均成功响应了脱衣请求。其中至少有一款应用在App Store的年龄分级仅为9岁以上。

报告详细说明了生成这些图像的简单程度,并展示了大量经过马赛克处理的测试结果作为证据。

以下是他们对其中一款应用的测试描述:

“在iOS版本中,当输入相同提示要求移除女性上衣时,应用未能生成图像并弹出敏感内容警告。但第二次请求显示女性穿着比基尼跳舞时却成功生成。无论是iOS还是Google Play版本,该应用首页都提供多种AI视频模板,包括‘撕衣服’、‘胸部抖动舞’、‘弯腰’等。”

报告最后总结称,虽然报告中列举的应用可能仅占实际存在的一小部分,但已足以表明:谷歌和苹果“并未有效监管自家平台,也未能切实执行相关政策”。

欲阅读完整报告,请点击此链接。